Hoy en día, la mayoría de los sistemas de IA generativa intentan resolver todo con un único "cerebro". Un modelo, un prompt, una respuesta.

Pero así no funcionan los sistemas más eficientes de la naturaleza. Algunas de las decisiones más complejas —como dónde debería vivir una colonia entera— se toman sin ninguna inteligencia central. Este es el caso de las abejas, y su capacidad para alcanzar consenso y resiliencia mediante la inteligencia colectiva: un concepto que todavía está muy poco explorado en los sistemas modernos de IA.

Este texto busca explicar, en términos simples, cómo estas ideas nos inspiraron en fjord para diseñar sistemas de IA que realmente funcionan fuera de una demo.

¿Qué problema estamos tratando de resolver?

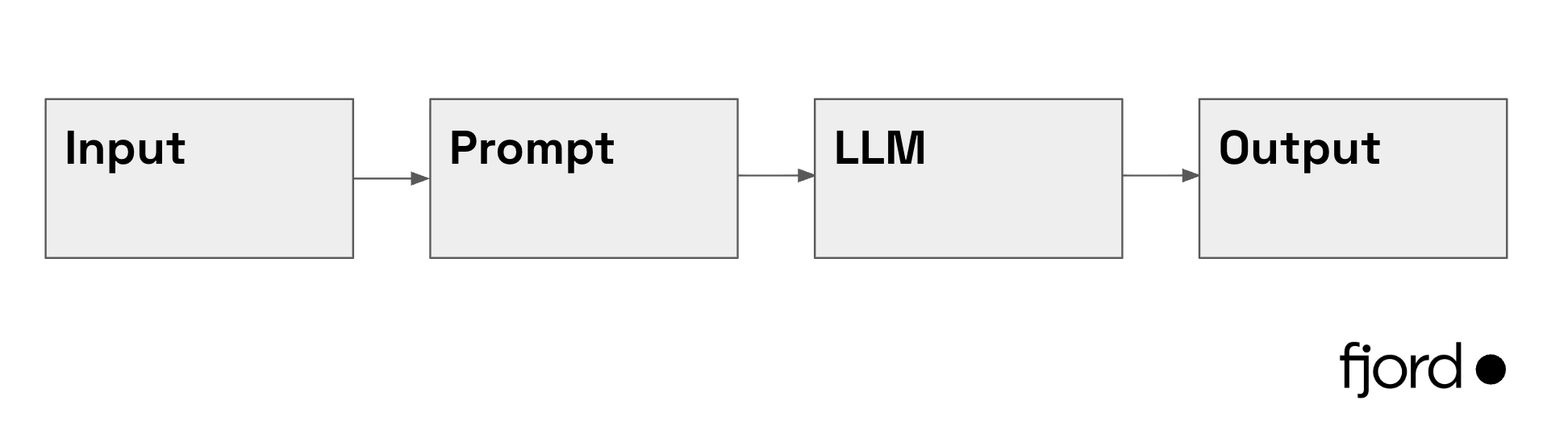

La mayoría de los sistemas de IA hoy están compuestos por:

Un input se inserta en un prompt, se envía al LLM (ChatGPT, Claude, etc.) y se espera una respuesta útil.

Esto funciona bien para muchas tareas simples, pero empieza a fallar cuando los problemas se vuelven complejos, ambiguos o multivariantes.

Poner toda la responsabilidad de éxito en esta única operación es frágil. Bajo presión, el sistema terminará alucinando, confundiéndose o hasta dando falsos positivos.

Lo vemos todo el tiempo:

- Un chatbot que funciona perfecto en demo y falla en producción.

- Un extractor que acierta el 80% de los casos y nadie puede explicar el otro 20%.

- Un sistema que no escala porque depende de un solo prompt cada vez más largo.

¿Por qué pasa esto?

Los LLMs, por más asombrosos que sean, no son omnipotentes. No podemos esperar que resuelvan solos problemas que requieren múltiples pasos, múltiples fuentes de información y múltiples validaciones.

Diseñar sistemas fundamentalmente centralizados va en contra de lo que nos enseñaron nuestras amigas abejas. Tal vez sea tiempo de volver al pizarrón.

¿Cómo resuelven decisiones complejas las abejas?

Cuando una colonia de abejas necesita un nuevo hogar, la decisión es crítica. Una mala elección puede significar la muerte de toda la colonia. El proceso es así:

- Exploradoras investigan distintos sitios de forma independiente.

- Cada exploradora vuelve y emite una señal cuya intensidad refleja la calidad del sitio.

- Otras abejas visitan y validan esas señales — no confían ciegamente.

- Las exploradoras que promueven sitios inferiores reciben señales de stop de sus rivales, suprimiendo activamente las opciones más débiles.

- Con el tiempo, las mejores opciones acumulan apoyo mientras las peores se filtran.

- La colonia converge en una decisión.

Sin autoridad central. Sin depender de un único actor. Solo contribuciones y un proceso de iteración constante. Cada abeja tiene una tarea simple y bien definida. Pero juntas forman un sistema de inteligencia colectiva potente y eficaz. Lo clave no es la biología — es la estructura: tareas especializadas, validación distribuida y convergencia.

¿Qué podemos aprender de ellas?

En vez de diseñar sistemas de IA donde toda la responsabilidad cae en un único nodo, podemos diseñar sistemas distribuidos con múltiples operaciones interconectadas (lo que en computación se conoce como un Grafo Acíclico Dirigido).

Un ejemplo concreto

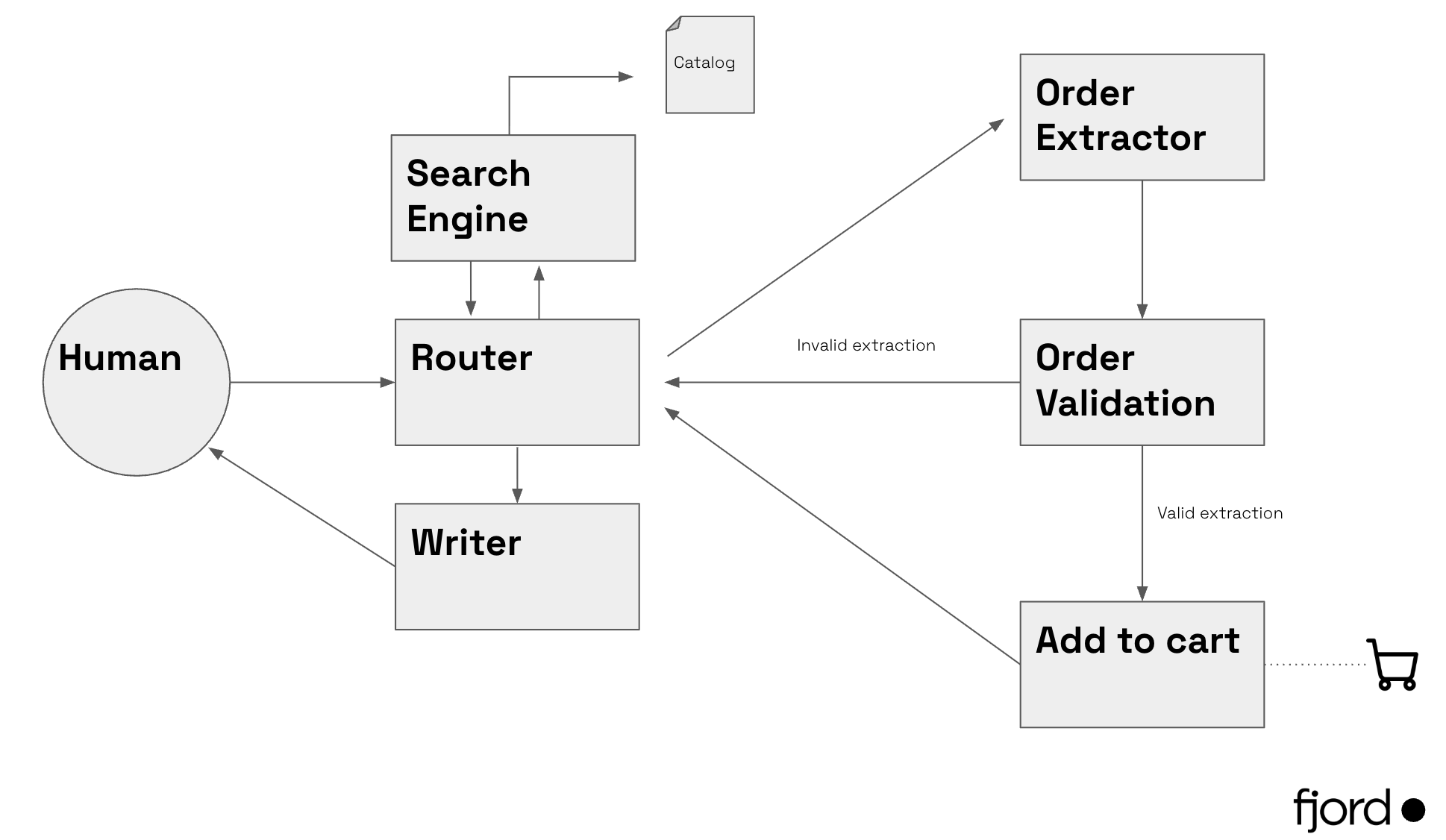

Imaginemos un chatbot de ventas que habla con clientes y tiene acceso al catálogo de productos y otros recursos. Un grafo simplificado se vería así:

Cada nodo tiene un rol específico y acotado:

- Router → Supervisa el proceso y selecciona cuál es el próximo paso.

- Buscador Catálogo → Busca en el catálogo artículos relacionados.

- Redactor → Redacta mensajes para el usuario (re-preguntas, confirmaciones, etc.).

- Extractor Orden → Extrae el SKU + cantidad que el cliente está buscando.

- Validación Orden → Valida que la extracción haya sido correcta.

- Agregar al Carrito → Si la extracción es válida, se agrega al carrito.

En lugar de apostar a una sola respuesta, obtenemos un proceso de descubrimiento y construcción continua.

Lo que requiere en la práctica

Estos sistemas no emergen solos. Requieren diseño, estructura e ingeniería deliberada:

- Roles y límites claros para cada agente o modelo. Si un nodo intenta hacer demasiado, vuelve a ser el problema original.

- El LLM correcto para cada tarea. No todo necesita GPT-4 o Claude Opus. Modelos más pequeños y especializados suelen ser más rápidos, baratos y predecibles para tareas acotadas.

- Protocolos de comunicación definidos. Los nodos necesitan hablar el mismo idioma — entradas y salidas en datos estructurados, no texto libre.

- Mecanismos de evaluación en cada paso. Sin métricas por nodo, no podés saber dónde falla el sistema. La observabilidad no es opcional.

- Datos estructurados como outputs. JSON, no prosa. Esto permite que los nodos se conecten sin ambigüedad.

Este enfoque tiene un costo de entrada más alto que un prompt largo. Pero es la diferencia entre un prototipo que impresiona y un sistema que funciona en producción con datos reales.

Conclusión

La naturaleza pasó millones de años resolviendo problemas de coordinación a escala. Abejas, hormigas y ecosistemas enteros no dependen de una inteligencia central. Dependen de interacción, consenso y coordinación.

Los sistemas de IA deben seguir el mismo camino.

En fjord creemos en sistemas bien diseñados — distribuidos para empresas que ya pasaron la fase de "probemos con un chatbot" y necesitan algo que realmente funcione. Si tu proceso hoy depende de un solo modelo haciendo demasiado, te podemos ayudar a escalarlo.